F: Was sind die wichtigsten Hardware-Faktoren für die lokale Ausführung von LLMs?

A:

Der VRAM deiner GPU und die AI-Rechenleistung sind die wichtigsten Faktoren für die lokale AI-Leistung, gefolgt vom System-RAM und einer modernen CPU. Ausreichend VRAM entscheidet darüber, wie groß das Modell maximal sein darf, das du effizient auf deinem PC ausführen kannst.

F: Welche GPUs eignen sich am besten für die Ausführung komplexer lokaler AI-Modelle (wie LLaMA, GPT, Mistral usw.) und die Bewältigung anspruchsvoller AI-Workloads?

A:

Die GeForce RTX 5090 mit 32 GB VRAM ist dank ihrer Tensor-Kerne der nächsten Generation eine der besten GPUs, die es derzeit für AI-Modelle und andere anspruchsvolle AI-Aufgaben gibt. Wenn du nach der günstigsten Option suchst, solltest du dich lieber für eine GeForce RTX 5070 Ti entscheiden.

F: Wie machen Tensor-Kerne die AI-Leistung auf GeForce RTX-GPUs besser?

A:

Tensor-Kerne machen AI-Aufgaben schneller, indem sie Matrixmultiplikationen mit gemischter Genauigkeit (wie FP16 oder FP8) machen, um die Leistung zu steigern, ohne dass es an Genauigkeit fehlt. Diese speziellen Hardware-Einheiten machen diese Operationen bis zu 30 Mal schneller als normale GPU-Kerne.

F: Wie viel VRAM braucht man für verschiedene Größen von AI-Modellen?

+

A:

Obwohl das von der verwendeten Genauigkeit abhängt und sich von Modell zu Modell unterscheidet, brauchen 7B-Modelle normalerweise 8 GB+, 13B-Modelle 16 GB+ und 30B-Modelle 24–30 GB VRAM. Größere Modelle brauchen vielleicht sogar noch mehr.

F: Ist NVIDIA oder Radeon besser für die Ausführung von AI-Workloads geeignet?

+

A:

NVIDIA ist im Allgemeinen besser für AI-Workloads geeignet, weil es breite Unterstützung, optimierte Bibliotheken, ein umfangreicheres Software-Ökosystem und viel leistungsstärkere GPUs mit großer VRAM-Kapazität bietet.

F: Wie stressig ist es, AI-Workloads auszuführen oder lokale AI auf meiner Hardware zu hosten, und kann das meine Komponenten beschädigen?

+

A:

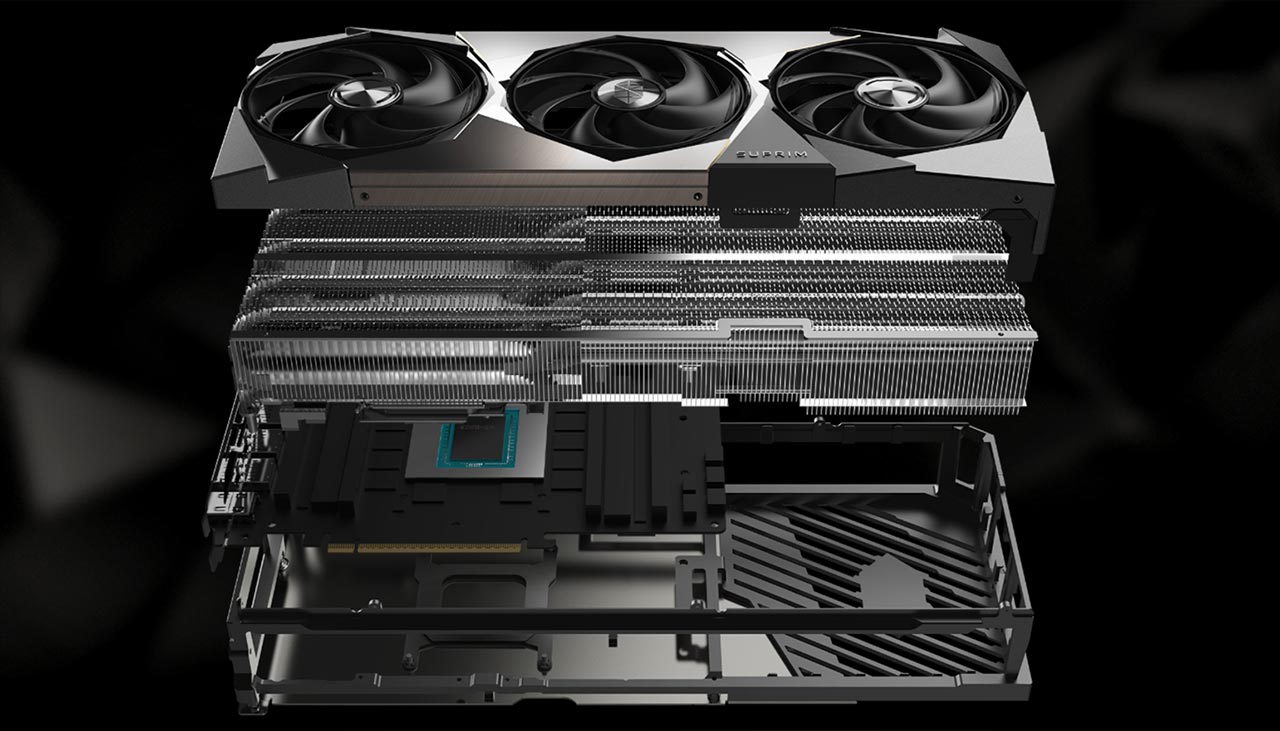

Das Ausführen von LLMs ist ähnlich stressig wie Gaming oder Rendering und macht die Hardware nicht kaputt, wenn die Kühlung gut ist. Gelegentliche hohe Belastungen sind für moderne Komponenten kein Problem, solange die Kühlung die Wärme gut wegschafft.

F: Was sind die Mindestanforderungen an den PC, um LLMs lokal laufen zu lassen?

+

A:

Mindestens 8–16 GB VRAM, 32 GB RAM und eine moderne 6-Kern-CPU sind empfehlenswert. Mehr RAM und VRAM machen größere, komplexere Modelle möglich und sorgen für besseres Multitasking.

F: Ist es besser, mehrere Low-End-GPUs oder eine einzige High-End-GPU zu verwenden?

+

A:

Eine einzelne High-End-GPU ist einfacher und passt viel besser zu einer Vielzahl von Anwendungen. Multi-GPU-Setups können zwar kostengünstiger sein, aber du solltest dir 100 % sicher sein, dass die Leistung deiner Workload mit mehreren GPUs gut skaliert, bevor du dich dafür entscheidest.

F: Wie wichtig ist die CPU im Vergleich zur GPU für die AI-Leistung?

+

A:

Die GPU ist viel wichtiger für die Inferenzgeschwindigkeit und die AI-Verarbeitung in Spielen, kreativen Apps usw. Die CPU kommt nur ins Spiel, wenn du Modelle ausführst, die größer als dein VRAM sind, oder wenn du CPU-spezifische Funktionen in einigen Apps nutzt.

F: Wie viel mehr Leistung bringt DLSS mit GeForce RTX-GPUs?

+

A:

DLSS auf GeForce RTX-GPUs kann die Gaming-Leistung um das 2- bis 4-fache steigern, indem es Bilder mit niedrigerer Auflösung hochskaliert und mit AI brandneue Frames rendert – für höhere Bildraten und bessere Bildqualität.

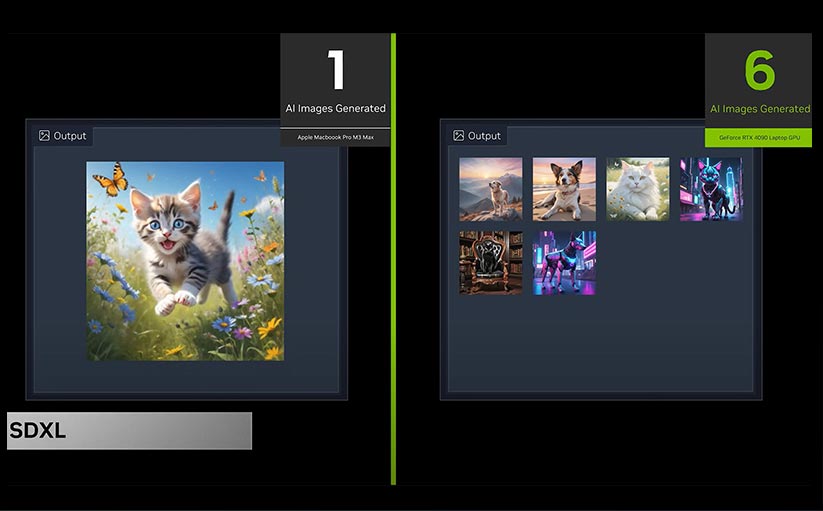

F: Wie schneiden GeForce RTX-GPUs im Vergleich zu den Chips der M-Serie von Apple bei lokalen AI-Verarbeitungsaufgaben ab?

+

A:

GeForce RTX-GPUs sind top in Sachen AI-Leistung, Skalierbarkeit und Unterstützung für das Ökosystem. Deshalb sind sie die erste Wahl für anspruchsvolle lokale AI-Aufgaben. Die Chips der M-Serie von Apple sind zwar effizient und passen super zu Mac-Workflows, aber am besten für einfachere oder plattformspezifische AI-Anwendungen geeignet.